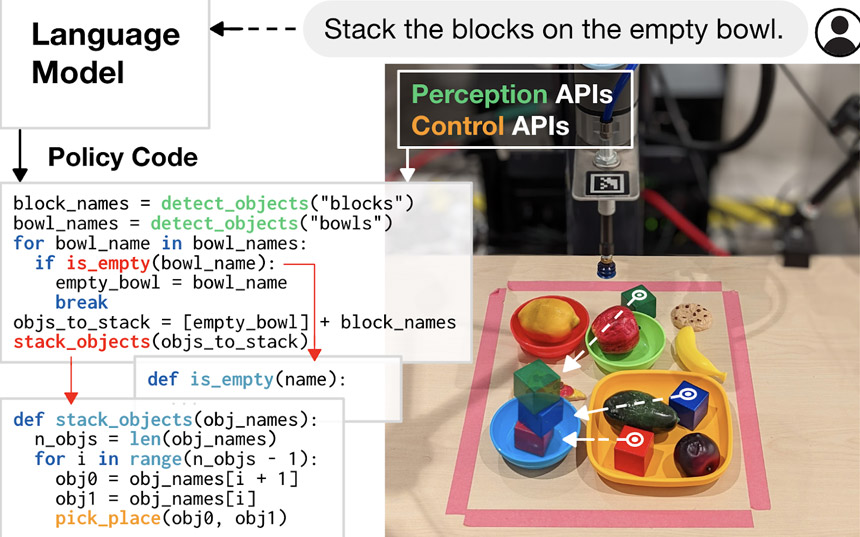

Google-ov Code as Policies (CaP) je sistem koji omogućava vještačkoj inteligenciji (AI) da kreira program koji će roboti pratiti, a sve na osnovu programskog jezika Python

Google razvija Code as Policies (CaP) koji će vještačkoj inteligenciji da da potpuno novu ulogu – da sama uči kako da piše kompjuterski kod. Ako to uspiju da ostvare, riješili bi problem nedostatka programera, ali i vjerovatno promijenili cijelu IT scenu.

Reč je o generativnoj vještačkoj inteligenciji, vrsti tehnologije koja koristi algoritme za kreiranje slika, video zapisa i drugog, a mi smo je mogli da upoznamo kroz program DALL-E koji od nekoliko riječi stvara potpuno nove slike.

Međutim, generativna vještačka inteligencija na kojoj Google radi bi se fokusirala na kreiranje i prečišćavanje računarskog koda, uz istovremeno održavanje kvaliteta tog koda kakav su postigli vrhunski programeri.

Kako su pisali na zvaničnom blogu, najnovija generacija njihovog jezičkog modela, kao što je PaLM, sposobna je za složeno rezonovanje i upoznata je sa milionima linija koda. Koristeći uputstva slična onima koja se koriste u učenju jezika, trenutni jezički modeli su se pokazali kao veoma efikasni kada je u pitanju pisanje generičkog koda, kao i koda koji mogu da kontrolišu roboti.

Tako je rođen Code as Policies (CaP), odnosno sistem koji omogućava vještačkoj inteligenciji da kreira program koji će roboti pratiti, a sve na osnovu programskog jezika Python.

„Naši eksperimenti su pokazali da je isporučeni kod doveo do poboljšane generalizacije i boljih performansi zadataka u poređenju sa direktnim podučavanjem robotskih zadataka i instrukcijama robota uobičajenim komandama. CaP omogućava da isti sistem obavlja čitav niz složenih i različitih robotskih zadataka bez prethodne posebne obuke“, istakli su naučnici zaposleni u Robotics at Google koji su razvili sistem.

Ograničenja i mogućnosti

Iako iz Google-a ističu da njihov CaP sistem ima određena ograničenja, on otvara i brojne mogućnosti za programiranje u budućnosti.

„Code as Policies je korak ka robotima koji mogu da modifikuju svoje ponašanje i, shodno tome, proširuju svoje mogućnosti. Ovo može da otvori čitav niz mogućnosti, ali i povećava potencijalne rizike jer sintetizovani programi (osim ako se ne provjeravaju ručno) mogu dovesti do neželjenog (robotskog) ponašanja. Ove rizike možemo da ublažimo tako što ćemo ugraditi bezbjednosne provjere koje ograničavaju kontrole kojima sistem može da pristupi. Međutim, potrebno je više rada da bi se osiguralo da su nove kombinacije jednako bezbjedne. Pozdravljamo široku diskusiju o tome kako minimizirati ove rizike uz maksimiziranje potencijalnih pozitivnih efekata na robote opšte namjene“, napisali su na kraju bloga Jacky Liang, stažista, i Andy Zeng, naučnik u Google-u, koji su radili na projektu.

Iako je njihov CaP sistem daleko od toga da može da stoji sam i kreira linije koda poput iskusnog programera, ipak pokazuje pravac u kojem bi se stvari mogle razvijati u budućnosti. Vještačka inteligencija, koja piše kod gotovo jednako dobro kao programer, može biti dobra stvar jer bi mogla da smanji pritisak na programere, ali postoji strah – da će vještačka inteligencija u potpunosti zamijeniti programere. Ako se to dogodi, hoćemo li moći nekako da držimo tu vještačku inteligenciju pod kontrolom ili idemo ka katastrofalnim scenarijima.

(Zimo)